从概念到实战:你的大数据终极指南

嘿,你是否好奇,海量数据如何转化为商业黄金?在数据洪流席卷全球的今天,高效挖掘数据价值已成为企业生存与创新的生死线。本文将带你从大数据核心特性出发,解密“分而治之”的智慧,并深入盘点主流技术生态,助你快速构建完整知识体系,抢占数据时代先机!

大数据究竟是什么?

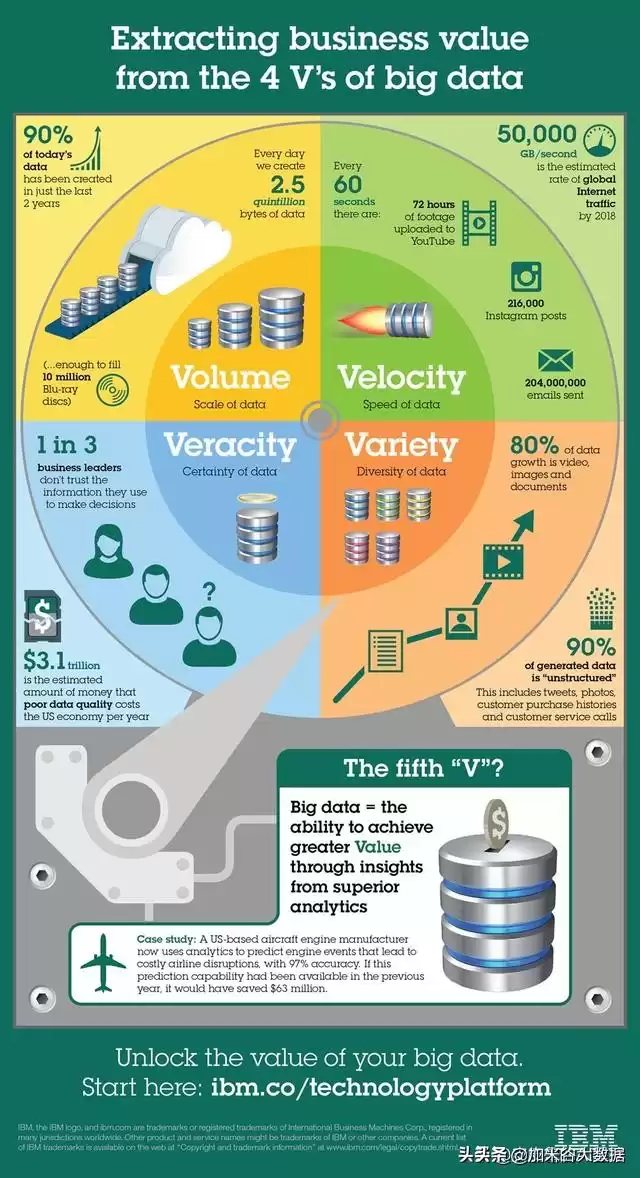

大数据,远不止“数据量大”这么简单。它是一套重塑商业逻辑的技术体系。IBM提出的5V模型,精准概括了其核心特征。

大数据的5V核心

Volume:数据体量巨大,从TB级到YB级。例如,全球数据总量已迈入ZB时代,相当于万亿GB级别。这让我们能对事物进行前所未有的全景洞察。Velocity:数据产生与处理速度极快。金融交易需毫秒级响应,推荐系统要实时捕捉用户兴趣。速度即优势,快一步就能决胜千里。Variety:数据类型极其多样。从结构化的数据库表格,到非结构化的图片、视频、传感器日志,多元数据融合催生创新。Veracity:数据真实性是基石。数据中混杂着噪声与偏差,清洗、关联异构数据以提炼高置信度信息,是挖掘价值的关键前提。Value:数据价值是终极目标。通过前4V,我们旨在驱动智能决策,解锁隐藏的财富密码。

在数据分析中,总体(Population)代表全部研究对象。传统方法常依赖样本(Sample)进行推断,但大数据技术打破了存储与算力枷锁,让我们能直接驾驭海量乃至全量数据。数据本身并非金矿,例如在诚信调查中,直接询问可能得到虚假回答,但融合多源数据(如征信记录、行为轨迹)进行交叉分析,才能逼近真相。

大数据以其巨量、高速、多样和真实性,最终服务于价值创造。随着技术演进,5V模型还衍生出动态性(Vitality)、可视性(Visualization)与合法性(Validity)等新维度,强调系统的活性、呈现的直观与合规的底线。

分布式计算:分而治之的艺术

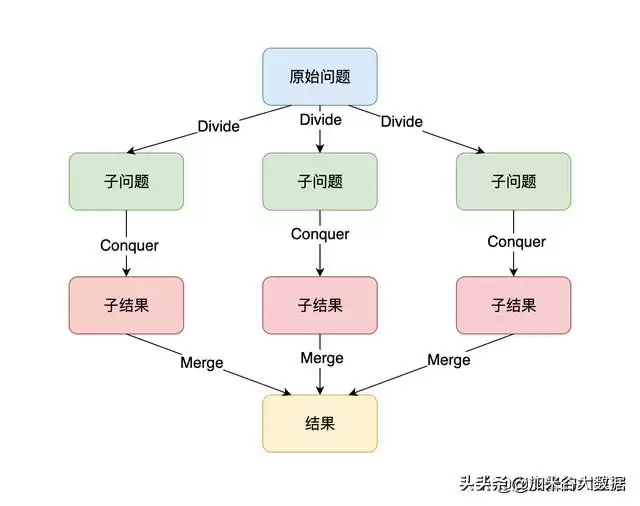

单机计算已无法应对数据洪流。将多台计算机组成集群进行分布式计算,成为处理大数据的标准答案。其核心思想正是“分而治之”。

分治法:化繁为简的战术核心

分治法将复杂问题拆解,在多个节点上并行求解,再汇总结果。分布式系统中的每个计算单元称为一个节点。早期方案如消息传递接口(MPI),提供了强大的进程间通信控制,但编程复杂、调试艰难,犹如精密手术,对开发者要求极高。

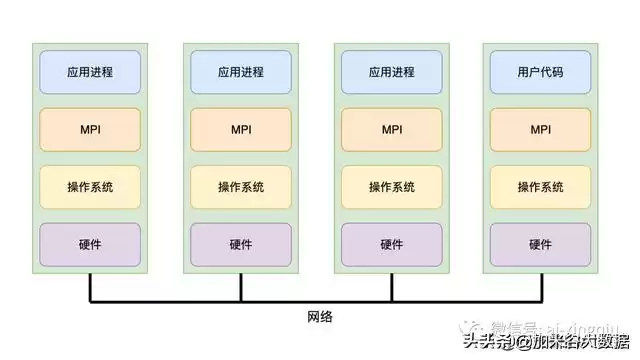

MPI并行计算:精细但复杂

MPI的核心是发送(Send)与接收(Recv)操作,赋予程序员底层控制权,性能优化潜力大,但开发效率低下,一个节点故障就可能导致全盘崩溃。

MapReduce:简化分布式编程的革命

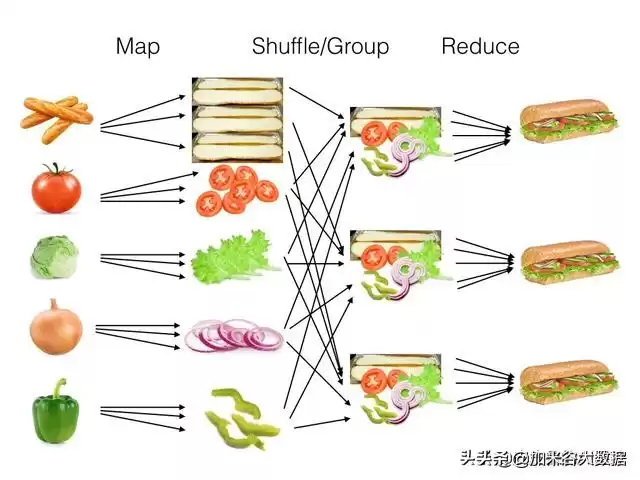

为降低门槛,MapReduce模型应运而生。它只需开发者定义map(映射)和reduce(归约)两个阶段,框架自动处理拆分、分发与汇总。

MapReduce:像流水线制作三明治

以制作三明治类比:map阶段并行处理各类食材(如切蔬菜、煎肉),shuffle阶段重组中间食材,reduce阶段最终组装成成品。这种模式极大提升了开发效率,催生了Hadoop、Spark、Flink等主流框架。

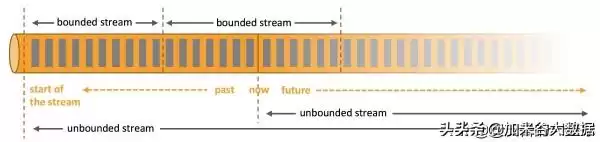

批处理与流处理:双轨战略数据流的本质

数据本质是持续不断的事件流。我们通常分析的是某个时间片段的数据集,但对实时数据流的处理需求正爆炸性增长。

从有限数据集到无限数据流

批处理:积蓄力量,一击必中

批处理针对累积成“批”的数据进行计算。如微信运动日榜、银行月账单生成。它适合对时效性要求不高的海量历史数据分析,是数据仓库ETL工作的核心。

流处理:瞬息万变,实时决胜

流处理直接对连续数据流进行即时分析。在金融风控、电商实时大屏、IoT监控等场景,毫秒级的延迟都可能意味着巨大损失或商机。5G与物联网的爆发,正将流处理推向战略新高地。

主流大数据技术矩阵

基于MapReduce思想,Hadoop、Spark、Flink三大框架各领风骚,构建起丰富的大数据生态。

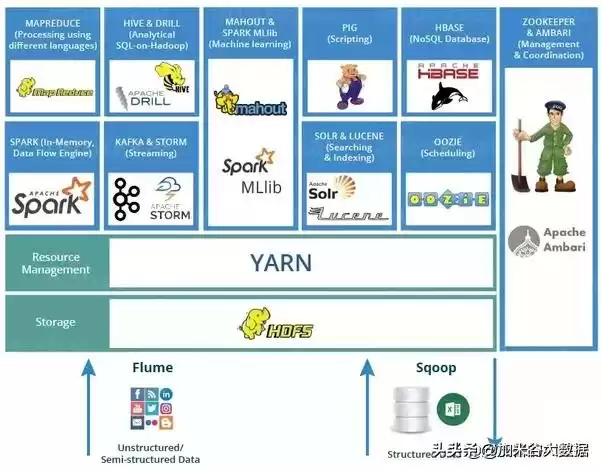

Hadoop:生态帝国的奠基者

Hadoop开源实现了MapReduce,并围绕核心三驾马车——MapReduce(计算)、HDFS(存储)、YARN(资源管理),构建了庞大的“动物园”生态。

零基础班大数据工程师培训,数据分析、数据挖掘,大数据开发,加米谷大数据培训机构

Hadoop庞大而完整的生态圈

其核心组件与生态工具包括:Hadoop MapReduce:批处理计算引擎。HDFS:高容错分布式文件系统。YARN:集群资源调度器。Hive:用SQL分析HDFS数据。HBase:支持毫秒查询的分布式数据库。Storm:早期流处理框架。Zookeeper:分布式协调服务。

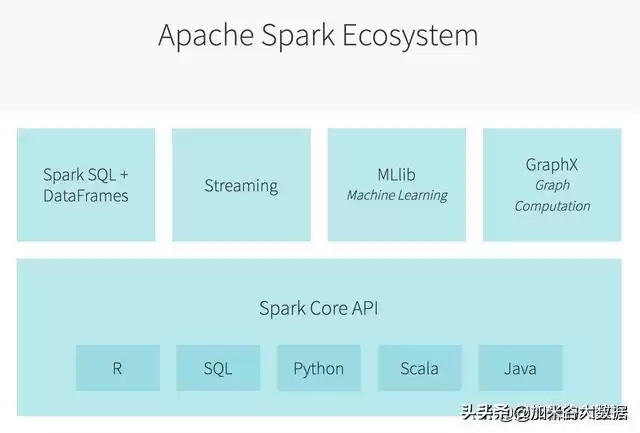

Spark:批处理的王者,速度的革命

Spark为提升Hadoop MapReduce而生,两大优势颠覆市场:

易用性:提供多语言API(Java、Scala、Python、R),支持SQL、机器学习、图计算,极大简化开发。极致速度:利用内存计算与DAG优化,性能相比Hadoop可提升百倍。

Spark:一体化、高性能的计算生态系统

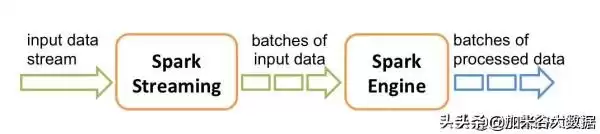

Spark核心聚焦计算,可与Hadoop生态无缝集成。其流处理组件Spark Streaming采用“微批处理”理念,将流数据切成小批量处理,实现了批流一体。

Spark Streaming的微批处理模式

Flink:流处理的新贵,未来的风向标

Flink生而为流。它采用真正的逐事件处理模型,支持精确一次(exactly-once)语义,保障数据绝对准确,在延迟与吞吐上表现卓越。

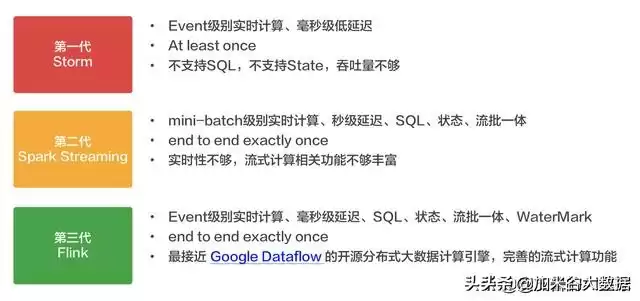

流处理技术的演进与对比

相比Storm的吞吐局限与Spark Streaming的微批延迟,Flink在实时性、准确性与资源效率上优势明显。它同样提供友好API,并与Hadoop生态深度融合。Flink将批处理视为有界流,正逐步统一批流架构。与Spark的竞争推动着整个技术栈飞速演进。

总结与展望

大数据处理的核心是“分而治之”的分布式计算。历经十余年发展,Hadoop奠定了坚实的生态基础,Spark在批处理领域称王,Flink则在流处理赛道引领风骚。技术选型需贴合业务场景:重历史分析选Spark,强实时需求用Flink,底层基建靠Hadoop。

技术蓝图已然绘就,你是否已跃跃欲试,想要亲手驾驭这些强大引擎?立即行动起来,从深入理解一个框架开始,踏上你的大数据征服之路!关注技术前沿,持续学习实践,你也能成为数据洪流的弄潮儿。

相关问答

大数据工程技术人员是做什么的?哪些专业可以入职?-红网问答

大数据工程技术人员职业定义:从事大数据采集、清洗、分析、治理、挖掘等技术研究,并加以利用、管理、维护和服务的工程技术人员。大数据工程技术人...

如何成为一个合格的大数据开发人才?需要具备哪些技术和经验?

随着大数据技术体系的逐渐成熟,大数据目前正处在落地应用的初期,整个大数据领域将陆续释放出大量的工作岗位,所以从事大数据相关岗位的发展空间还是比较广阔的...

大数据开发跟大数据平台开发有区别吗?-幸福里问答

首先,大数据开发通常指的是基于大数据产业链的一系列开发任务,涉及到大数据平台开发、大数据应用开发、大数据分析等,另外还包括数据采集产品的开发...

大数据专业学什么适合女生学吗

[回答]大数据技术专业属于交叉学科:以统计学、数学、计算机为三大支撑性学科;生物、医学、环境科学、经济学、社会学、管理学为应用拓展性学科。此外还需...

大数据属于前端还是后端?

大数据的分析逻辑以及数据的采集,属于后端。数据展示可以是web前端,也可以是APP应用或pc应用等等。python可以做web后端开发,但python不只是可以做后端。前...

大数据有哪些重要的作用?-汇财吧专业问答

[回答]“大数据”是指以多元形式,自许多来源搜集而来的庞大数据组,往往具有实时性。在企业对企业销售的情况下,这些数据可能得自社交网络、电子商务网站、...

数据科学与大数据技术专业是干什么的_瑞文网

数据科学与大数据技术主要研究计算机科学和大数据处理技术等相关的知识和技能,从大数据应用的三个主要层面(即数据管理、系统开发、海量数据分析与挖掘)出发...

Web前端开发与大数据技术应用哪个好?

3.如果你对数据处理、数据分析和机器学习等方面感兴趣,那么大数据技术应用可能更适合你。大数据技术应用涉及数据挖掘、数据存储和数据处理等技术,可以帮助企...

新技术、新发明层出不穷,以文字为载体的数据量大约每10年...

科学大数据与数字地球郭东华等①19世纪70年代以来,随着第二次工业革命的爆发,新技术、新发明层出不穷,以文字为载体的数据量大约每10年翻一番;从工业化时代进...

贵州师范大学大数据与计算机科学学院怎么样?设有哪些专业?...

[回答]~接下来我为大家简单介绍一下我们贵州师范大学的大数据与计算机科学学院开设的专业以及研究情况专业设置:计算机科学与技术专业、数据媒体技术专业...